Moderovanie obsahu je pre správu online komunít kľúčové. Tento blog sa zaoberá nezastupiteľnou úlohou ľudských moderátorov obsahu, skúma ich jedinečné schopnosti v porovnaní s AI, výzvy, ktorým moderácia čelí, a najlepšie riešenia. 👩💻

Obsah:

Ľudský úsudok pri moderovaní obsahu je nevyhnutný a nenahraditeľný automatizáciou. Algoritmy spracúvajú dáta rýchlo, ale chýba im pochopenie nuáns a empatia človeka. Ľudskí moderátori dokážu interpretovať kontext, kultúrne nuansy a jemné náznaky, rozlišovať medzi sarkazmom a nenávistnými prejavmi alebo humorom a obťažovaním. Ak sa napríklad influencer opýta na vaše obľúbené zviera, komentár typu „Potkany!“ by bol neškodný. Pod príspevkom o celebritách, politikoch, novinároch atď. by však ten istý komentár bol urážlivý a toxický. Umelá inteligencia si to všimne len zriedka, ľudia však vždy. Toto odlišné chápanie zabezpečuje primerané štandardy obsahu. Ľudský úsudok tiež ponúka flexibilitu pri rozhodovaní, riešení nových sociálnych situácií, ktoré nezodpovedajú vopred stanoveným pravidlám.

Ak by sme sa mali podeliť o príklad z praxe: Po pokuse o atentát na slovenského premiéra 15. mája 2024 modely AI neskrývali komentáre oslavujúce túto tragédiu (násilné komentáre), ale naši moderátori áno.

Zistili sme, že pod príspevkami stránok, ktoré používali iba nástroj na moderovanie s AI, bola miera skrytia 25 %, zatiaľ čo kombinácia ľudských moderátorov a AI elv.ai zistila 51 % mieru toxicity.

sa oplatí.

Podľa štúdií elv.ai prechádza ľudský moderátor obsahu v priemere 300 komentárov za hodinu. V kombinácii s umelou inteligenciou tento počet výrazne narastá, a to na viac ako 1 500 komentárov za hodinu. Kombináciou oboch sme zároveň dosiahli 3 skvelé veci:

“Kombinácia umelej inteligencie a ľudských moderátorov je podľa výskumov najefektívnejším spôsobom moderovania obsahu.”

Mandy Lau, York University, 2022

Automatizované nástroje na moderovanie obsahu sú neoceniteľné pri počiatočnej kontrole obsahu, pri ktorej sa rýchlo identifikuje a označí potenciálne škodlivý obsah. Tieto nástroje dokážu spracovať veľké objemy dát, čo umožňuje ľudským moderátorom sústrediť sa na komplexnejšie prípady, ktoré si vyžadujú podrobnú analýzu a pochopenie súvislostí.

Ľudskí moderátori vynikajú v analýze zložitých prípadov, ktoré si vyžadujú detailný úsudok. Ich schopnosť porozumieť kontextu, kultúrnym nuansám a emocionálnym náznakom ich robí nenahraditeľnými pri konečnom rozhodovaní o obsahu. Toto zameranie sa na komplexné prípady zabezpečuje, že moderovanie obsahu si zachováva vysoký štandard presnosti a spravodlivosti.

Zavedenie jasných usmernení a pravidelné školenia pre automatizované systémy aj moderátorov sú veľmi dôležité. Dôsledné školenia zabezpečia, že moderátori budú dobre pripravení na prácu s rôznorodým a vyvíjajúcim sa obsahom, zatiaľ čo usmernenia pomôžu zachovať jednotnosť rozhodovania.

Ľudskí moderátori obsahu sú nevyhnutní, ale môžu byť drahí kvôli mzdovým nákladom spojeným s veľkými tímami. Na druhej strane, moderovanie obsahu pomocou AI môže byť nákladovo efektívnejšie v závislosti od nárokov organizácie. Náklady na softvér AI sa líšia v závislosti od faktorov, ako sú preferencie spoločnosti a konkrétne nástroje AI potrebné na konkrétne úlohy.

Moderovanie obsahu pomocou AI dokáže regulovať obsah rýchlejšie, ako by to dokázal človek, čo je ideálne na spracovanie veľkého množstva obsahu. Ľudskí moderátori však dokážu lepšie zachovať presnosť regulácie obsahu, keď ide o subjektívne myšlienky. Ich schopnosť interpretovať jemné rozdiely v obsahu, ako je napríklad sarkazmus alebo kultúrne referencie, zabezpečuje presnejšiu a kontextovo vhodnejšiu moderáciu.

Každodenný nárast obsahu vytváraného používateľmi (user-generated content/UGC) a prítomnosť nevhodných tém môžu preťažovať moderátorov a ovplyvňovať ich efektivitu. Automatizovaná moderácia obsahu môže zvládnuť značnú časť tohto procesu, čím chráni ľudských moderátorov pred vystavením najurážlivejšiemu materiálu a umožňuje im sústrediť sa na jemnejšie prípady.

Údaje z reportov DSA o transparentnosti odhaľujú rozsah automatizovanej a ľudskej moderácie na najväčších platformách. Napríklad platformy ako Facebook a Instagram sa vo veľkej miere spoliehajú na automatizované rozhodnutia, pričom ľudská moderácia tvorí len malé percento. Platformy ako TikTok a X (predtým Twitter) však majú vyšší podiel ľudskej moderácie, čo poukazuje na pretrvávajúcu potrebu ľudského dohľadu nad moderovaním obsahu. 👇

Graf: Počet automatizovaných rozhodnutí o moderovaní obsahu a rozhodnutí o moderovaní obsahu ľuďmi v %, ktoré platformy uviedli v prvom výkaze DSA o transparentnosti.

Kombinácia automatizácie s ľudským vhľadom zvyšuje bezpečnosť používateľov a dodržiava komunitné štandardy. Automatizované nástroje poskytujú rýchlosť a efektívnosť potrebnú na správu veľkého množstva obsahu, zatiaľ čo ľudskí moderátori ponúkajú detailné pochopenie potrebné na komplexné rozhodnutia. Tento vyvážený prístup zabezpečuje bezpečnejšie a inkluzívnejšie online prostredie.

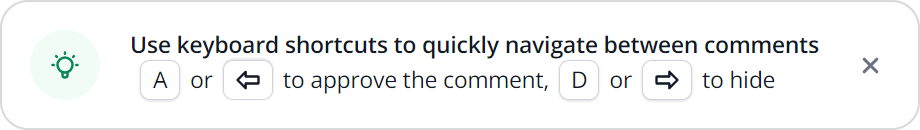

Na rozdiel od väčšiny moderátorských pozícií ponúkame my v elv.ai našim moderátorom obsahu gamifikáciu v aplikácii. Predstavujeme vám Focus mode – spôsob, ako sa dostať cez svoju zmenu jeden komentár za druhým len pomocou ⬅️klikania na šípky➡️, ako v jednoduchej videohre. Takto je všetka manuálna práca vykonaná tak efektívne, ako je to len v ľudských silách!

V elv.ai sa neplytvá pracovnou silou na boj so softvérom. Veríme, že najlepší spôsob moderovania je ten najjednoduchší, aby všetka energia našich moderátorov mohla byť vložená do kritického myslenia a rozhodovania. Inými slovami: Menej starostí, viac úspechov! 🫶

Mohli by sme o tom hovoriť celý deň, ale čo je lepšie, ako sa o tom presvedčiť pomocou vlastnej skúšobnej verzie zdarma? Radi vám ukážeme, ako kombinované moderovanie obsahu vyzerá v praxi.

Bojujeme proti hoaxom, dezinformáciám a nenávisti na sociálnych sieťach.